MAP 311 - X2013benaych/Cours2-25042014.pdf · 2014. 4. 25. · MAP 311 - X2013 Fin de la Leçon 1:...

Transcript of MAP 311 - X2013benaych/Cours2-25042014.pdf · 2014. 4. 25. · MAP 311 - X2013 Fin de la Leçon 1:...

-

MAP 311 - X2013

Fin de la Leçon 1: Variables aléatoires2

Rappel: nous avons construit l’espace de probabilité (Ω,A,P), avec uneapproche ensembliste.

2MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires3 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 1/ 35

-

Variable aléatoire et sa loi4

Modèles aléatoires sophistiqués: Point de vue fonctionnel plutôtqu’ensembliste.

Définition

(Ω,A,P) donné. Une variable aléatoire est une grandeur qui dépend durésultat de l’expérience. Mathématiquement, c’est une fonction

X : Ω −→ F , ω 7→ X (ω).

Exemples:Le nombre de piles obtenus sur 100 lancers d’une pièce: F = {0, . . . , 100}.La distance du point d’atteinte d’une flèche au centre de la cible: F = [0, 15].

La valeur maximale d’un prix d’actif boursier sur un intervalle de temps donné:F = R+.

4MAP 311, Chapitre 2, Section 2.4Fin de la Leçon 1: Variables aléatoires5 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 2/ 35

-

Enorme intérêt

L’espace F = X (Ω) sera connu et simple (sous-ensemble de R ou de Rd ), etpermettra de faire des calculs.(Ω est un espace souvent difficile à décrire, voire totalement abstrait.)

Plutôt que de travailler sur l’espace de probabilité (Ω,A,P), on va étudierles chances de réalisation des valeurs de X .

Notation: Pour B ⊂ F , on note

{X ∈ B} = {ω,X (ω) ∈ B} = X−1(B);P(X ∈ B) = P({ω,X (ω) ∈ B}).

Remarque: {B,X−1(B) ∈ A} est une tribu sur F , qui n’est en général paségale à P(F ).

Fin de la Leçon 1: Variables aléatoires6 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 3

/ 35

-

Théorème

Pour B ⊂ F tel que X−1(B) ∈ A, on pose:

PX (B) = P(X−1(B)) = P({ω,X (ω) ∈ B}).

Alors PX est une probabilité sur F = X (Ω).

DéfinitionLa Probabilité PX s’appelle la loi de X.C’est la mesure image de P par l’application X.

Remarque

PX est beaucoup plus facile à caractériser que P car F est connu dans lapratique.

Fin de la Leçon 1: Variables aléatoires7 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 4

/ 35

-

Exemple

Lancer de deux dés. Ω = {(i , j) : 1 ≤ i ≤ 6; 1 ≤ j ≤ 6}, probabilité uniforme:P({ω}) = 136 pour chaque {ω}.X = Somme des résultats des deux dés. X : Ω→ {2, . . . ,12} définie parX (i , j) = i + j . Elle a pour loi

PX (B) =nombre de couples (i , j) tels que i + j ∈ B

36.

Ainsi,

PX ({2}) = P(X = 2) =136

= PX ({12}) = P(X = 12),

PX ({3}) = PX ({11}) =2

36, PX ({4}) = PX ({10}) =

336,

PX ({5}) = PX ({9}) =4

36, PX ({6}) = PX ({8}) =

536,

PX ({7}) =6

36.

Comportement aléatoire de X décrit par {(xi ,pi ), 2 ≤ i ≤ 12}.Fin de la Leçon 1: Variables aléatoires8 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 5/ 35

-

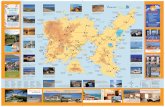

Fréquences théoriques (en vert) et résultats obtenus (en rouge) pour 100lancers de dés.

Fin de la Leçon 1: Variables aléatoires9 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 6

/ 35

-

Leçon 2

Variables aléatoires sur un espace finiou dénombrable10

10MAP 311, Chapitre 3Fin de la Leçon 1: Variables aléatoires11 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 7/ 35

-

Ω fini ou dénombrable12

F = X (Ω) = {x1, . . . , xi , . . .} est dénombrable.

Rappel: Une probabilité sur F est caractérisée par les probabilités de sessingletons.

Proposition

La loi PX de X est caractérisée par

{(xi ,pXi ), xi ∈ F}, avec pXi = P(X = xi ) = PX ({xi}). (1)

Important:La loi PX de X est caractérisée par (1) dès que F = X (Ω) estdénombrable, (même si Ω ne l’est pas).

En effet, les ensembles {ω,X (ω) = xi} forment une partition de Ω.

12MAP 311, Chapitre 3, Section 3.2Fin de la Leçon 1: Variables aléatoires13 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 8/ 35

-

Variables aléatoires discrètes usuelles14

• Ω = {Pile,Face}, p ∈]0,1[. On pose: X = 1 si Pile, X = 0 si Face.PX (1) = P(X = 1) = p , PX (0) = 1− p.

La loi de X est appelée loi de Bernoulli de paramètre p.

• Infinité de lancers indépendants: loi du premier succès.

P(1er pile au k -ième lancer ) = P(FF . . .FP) = p (1− p)k−1.

Définition

Une variable géométrique de paramètre p ∈]0,1[ est une variable àvaleurs dans N∗ telle que ∀k ∈ N∗,

P(X = k) = p (1− p)k−1.

14MAP 311, Chapitre 3, Section 3.5Fin de la Leçon 1: Variables aléatoires15 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 9/ 35

-

• Variable aléatoire binomiale de paramètres n et p

Sn = nombre de Piles obtenus après n lancers indépendants.

Sn =∑n

i=1 Xi ; Sn(Ω) = {0, · · · ,n}.

P(Sn = k) = P(ω ∈ Ω,∑n

i=1 Xi (ω) = k) =(n

k

)pk (1− p)n−k .

Définition

La loi de Sn est appelée loi binomiale de paramètres n ∈ N∗ et p ∈]0,1[que l’on note B(n,p).

Fin de la Leçon 1: Variables aléatoires16 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 10

/ 35

-

Exemple: un modèle de génétique des populationsLe modèle de Wright-Fisher.

Population de taille N constante.

A chaque génération, l’ancêtre d’un individu est choisi uniformément auhasard dans la génération précédente.

Nombre d’enfants D d’un individu: loi binomiale B(N, 1N ).

P(D = k) =(

Nk

)(1N

)k (1− 1

N

)N−k.

(On distingue chaque individu).

Les effets des fluctuationsaléatoires de la population: ladérive génétique.

Fin de la Leçon 1: Variables aléatoires17 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 11

/ 35

-

Supposons que N = 100.

Probabilité pour que le nombre d’enfants soit inférieur à 4?

P(X ≤ 4) = P(X = 0) + P(X = 1) + P(X = 2) + P(X = 3) + P(X = 4)=∑4

k=0

(100k

)(0, 01)k (0, 99)100−k = 0, 9964.

• Variable aléatoire de Poisson

Modélisation des réalisations d’un événement rare.

Soit B(n,an) avec nan → θ ∈ R∗+ quand n→ +∞.

pk (an,n) ={ (n

k

)(an)k (1− an)n−k si k ≤ n

0 si k ≥ n + 1.

Alors on a:

limn→∞

pk (an,n) = pk = e−θθk

k !, ∀k ∈ N.

Fin de la Leçon 1: Variables aléatoires18 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 12

/ 35

-

Définition

On appelle variable aléatoire de Poisson de paramètre θ > 0 une v.a. X àvaleurs dans N telle que

P(X = k) = e−θθk

k !, ∀k ∈ N.

Sa loi est la loi de Poisson de paramètre θ notée P(θ).

Exemple 1 précédent: On peut approcher X (en loi) par une variable aléatoire Zde loi de Poisson P(1).Vérifions que l’approximation est très bonne.

k P(X = k) P(Z = k)0 0,3660 0,36791 0,3697 0,36792 0,1848 0,18393 0,0610 0,06134 0,0149 0,0153

Fin de la Leçon 1: Variables aléatoires19 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 13

/ 35

-

Le processus de Poisson:Apparitions d’un événement rare au cours du temps.

Probabilité qu’il advienne pendant un intervalle de temps Ih de longueurh: λh + o(h).probabilité de deux événements ou plus pendant Ih: o(h).Indépendance des occurences sur des intervalles de temps disjoints.

Alors N(t) = nombre d’apparitions de l’événement sur [0, t ] est une variablede Poisson de paramètre λt .

Processus de Poisson: t → N(t).Exemple.Nombre de crises financières mondiales: processus de Poisson, λ = 1. (Unité detemps: année).

Probabilité de plus de 2 crises dans les 3 prochaines années:

P(N(3) ≥ 2) = 1− P(N(3) = 0)− P(N(3) = 1)= 1− e−3 − 3e−3 = 1− 4e−3 ' 0, 8.

Fin de la Leçon 1: Variables aléatoires20 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 14

/ 35

-

Espérance21

Motivation: Donner un résumé quantitatif de la variable aléatoire X .

n observations: X1, . . . ,Xn valeurs successives prises par X .

Moyenne arithmétique: X1+...+Xnn .

Modèle abstrait:Mn =

∑ω∈Ω fn({ω}) X (ω), où fn fréquence empirique.

Définition

Si E(|X |) =∑ω∈Ω pω |X (ω)| < +∞, on appelle espérance de X le nombre

E(X ) =∑ω∈Ω

pω X (ω).

Théorème

Si E(|X |) < +∞, E(X ) =∑

xi∈F xi P(X = xi ).21MAP 311, Chapitre 3, Section 3.3

Fin de la Leçon 1: Variables aléatoires22 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 15

/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16

/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires23 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

L1 est l’espace vectoriel des variables aléatoires X telles que E(|X |) < +∞.

Propriétés: (immédiates à partir de la définition)

Linéarité: E(aX + bY ) = aE(X ) + b E(Y ).

Si X (ω) = a pour tout ω, alors E(X ) = a.

|E(X )| ≤ E(|X |).

Positivité: Si X ≥ 0, alors E(X ) ≥ 0.

Si X ≤ Y , alors E(X ) ≤ E(Y ).

Si Ω est fini, toutes les variables aléatoires sont dans L1.

Remarque fondamentale: A ⊂ Ω et X = 1A: X (ω) = 1 si ω ∈ A etX (ω) = 0 si ω /∈ A.

E(X ) = E(1A) = P(A).

23MAP 311, Section 2.4Fin de la Leçon 1: Variables aléatoires24 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 16/ 35

-

Théorème

Soit f : F → R, telle que E(|f (X )|) < +∞,

E(f (X )) =∑xi∈F

f (xi )P(X = xi ).

Même preuve que pour l’espérance.

Définition

Supposons que E(X 2)

-

Ecart-type de X

σX =√

Var(X ).

Exemple: Evolution de deux titres fictifs, l’un très volatil et l’autre peu volatil.Observations toutes les unités de temps. Les variations sont indépendantes et demême loi.Ces deux titres valent 100 au départ, 110 à la fin, ont tous deux une moyenne de105,52. L’écart type est égal à 16,24 pour le premier et à 1,32 seulement pour lesecond.

Fin de la Leçon 1: Variables aléatoires26 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 18

/ 35

-

Fonction génératrice

Définition

Pour X variable aléatoire à valeurs dans N, et s ∈ [0,1],

GX (s) = E(sX ) =∑

n

pn sn, où pn = P(X = n).

Proposition

1) GX continue sur [0,1], C∞ sur [0,1[. Elle caractérise la loi de X.

2) X ∈ L1 ⇐⇒ GX dérivable (à gauche) en s = 1, et

E(X ) = G′X (1).

3) X (X − 1) . . . (X − p) ∈ L1 ⇐⇒ GX est p + 1 fois dérivable en 1, et

E (X (X − 1) . . . (X − p)) = G(p+1)X (1).

Fin de la Leçon 1: Variables aléatoires27 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 19

/ 35

-

Calcul de moments

X Variable de Bernoulli: E(X ) = p ,Var(X ) = p(1− p).

X Variable binomiale B(n,p):

GX (s) =n∑

k=0

(nk

)pk (1− p)n−k sk = (1− p + ps)n

E(X ) = pn ; Var(X ) = np(1− p).

X Variable de Poisson P(θ):

GX (s) =∑

k

skθk

k !e−θ = eθ(s−1)

E(X ) = θ ; E(X (X − 1)) = θ2

Var(X ) = E(X (X − 1)) + E(X )− (E(X ))2

= θ2 + θ − θ2 = θ.

Fin de la Leçon 1: Variables aléatoires28 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 20

/ 35

-

Couple de variables aléatoires, cas discretOn veut décrire l’évolution aléatoire conjointe de deux variables aléatoires Xet Y .

Exemple: Z = (X ,Y ) décrit le nombre d’années d’études et le nombre de frères etsoeurs de l’aîné d’une famille.

X (Ω) = F ; Y (Ω) = G et Z (Ω) = F ×G est dénombrable.

Loi jointe du couple Z = (X ,Y ): probabilité PZ sur F ×G, caractériséepar

PZ ({(x , y)}) = P(X = x ; Y = y).

Lois marginales: les lois respectives PX et PY de X et de Y :

PX(x) = P(X = x) =∑y∈G

P(X = x ; Y = y) =∑y∈G

PZ (x , y),

PY(y) = P(Y = y) =∑x∈F

PZ (x , y).

Fin de la Leçon 1: Variables aléatoires29 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 21

/ 35

-

Lois conditionnelles30

Définition

xi est fixé tel que PX(xi ) > 0. La loi conditionnelle de Y sachant X = xi est laprobabilité sur G définie pour tout yj par:

PY |X=xi (yj ) = P(Y = yj |X = xi ) =P(X ,Y )(xi , yj )

PX(xi ).

On suppose E(Y )

-

Exemple: Invasion et fixation d’un mutant

Deux types: deux allèles A (lesrouges) et a (les jaunes).

Soit Zn = nombre d’individus d’allèle a à la génération n.

P(Zn+1 = j |Zn = i) =(

Nj

)(iN

)j (1− i

N

)N−j.

E(Zn+1|Zn = i) = NiN

= i ; Var(Zn+1|Zn = i) = NiN

(1− i

N

)= i(

1− iN

).

Ainsi,

E(Zn+1|Zn) = Zn ; Var(Zn+1|Zn) = Zn(

1− ZnN

).

On peut montrer (cours MAP 432): Quand le nombre de générations n tend versl’infini, la suite (Zn)n tend vers 0 (fixation de A) ou vers N (fixation de a).Fin de la Leçon 1: Variables aléatoires32 () MAP 311 - X2013

Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 23/ 35

-

Variables aléatoires indépendantes33

Définition

Les variables aléatoires sont dites indépendantes si,

∀i, j, P(X = xi ,Y = yj ) = P(X = xi )P(Y = yj )⇐⇒ ∀A ⊂ F , ∀B ⊂ G, P(X ∈ A,Y ∈ B) = P(X ∈ A)P(X ∈ B).

Proposition

Si X et Y sont indépendantes, et si E(|f (X )|)

-

Exemple

Soit M une matrice carrée aléatoire de taille 2× 2 dont les coefficients Xi,jsont des variables aléatoires indépendantes, telles que P(Xi,j = ±1) = 12 .

Calculons la variance du déterminant de M.

Fin de la Leçon 1: Variables aléatoires35 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 25

/ 35

-

Somme de variables aléatoires indépendantes

Proposition

Soient X et Y des v.a. à valeurs entières, et Z = X + Y. Alors

P(Z = i) =∑

j

P( (X ,Y ) = (j, i − j)).

En particulier, si X et Y sont indépendantes,

P(Z = i) =∑

j

P(X = j)P(Y = i − j) =∑

j

P(X = i − j)P(Y = j).

Proposition

Si X et Y indépendantes, alors GX+Y (s) = GX (s) GY (s).

Preuve: Par indépendance,GX+Y (s) = E(sX sY ) = E(sX )E(sY ) = GX (s) GY (s).

Fin de la Leçon 1: Variables aléatoires36 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 26

/ 35

-

Stabilité par indépendance

1) Somme de n v.a. de Bernoulli de paramètre p indépendantes: v.a.binomiale B(n,p): G(s) = (1− p + ps)n.

2) X et Y des v.a. indépendantes de lois de Poisson de paramètres λ, µ.

GX+Y (s) = GX (s)GY (s) = exp(λ(s − 1)) exp(µ(s − 1))= exp((λ+ µ)(s − 1)).

=⇒ X + Y a une loi de Poisson de paramètre λ+ µ, car la fonctiongénératrice caractérise la loi.

Fin de la Leçon 1: Variables aléatoires37 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 27

/ 35

-

Exercice

Peut-on piper deux dés de telle sorte que la somme des points soituniformément répartie sur {2,3, · · · ,12}?

Fin de la Leçon 1: Variables aléatoires38 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 28

/ 35

-

POUR EN SAVOIR PLUS · · ·

Fin de la Leçon 1: Variables aléatoires39 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 29

/ 35

-

Le processus de Galton-Watson

- Chaque individu d’une génération meurt et laisse place à un nombrevariable d’enfants.

- A chaque instant n, la variable aléatoire Xn désigne la taille de la populationau temps n.

X0 = 1 ; Xn =Xn−1∑i=1

Yi,n.

Les (Yi,n)i,n sont indépendantes et de même loi (pk )k∈N.

(N. Berglundt)

Fin de la Leçon 1: Variables aléatoires40 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 30

/ 35

-

Extinction et Persistence

On suppose que m = E(Y ) =∑

k≥1 k pk < +∞.

Fonction génératrice de la loi de reproduction: ∀s ∈ [0,1],

g(s) = E(sY ) =∑

k

pk sk ; g(1) = 1 ; g(0) = p0 ; m = g′(1).

C’est une fonction convexe et croissante.

Soit gn la fonction génératrice de Xn (avec X0 = 1).

On a la relation de récurrence:

gn(s) = gn−1 ◦ g(s) = g ◦ g ◦ . . . ◦ g(s) (n fois).

gn(s) = E(sXn ) = E(

s∑Xn−1

i=1 Yi,n

)= E

(E(

s∑Xn−1

i=1 Yi,n |Xn−1))

= E(

ΠXn−1i=1 E

(sYi,n

))= E

([E(sY )]Xn−1

)= E

([g(s)]Xn−1

)= gn−1 ◦ g(s).

Fin de la Leçon 1: Variables aléatoires41 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 31

/ 35

-

Probabilité d’extinction à la génération n : qn = gn(0). On a alors

qn = g(qn−1).

C’est une suite définie par récurrence.

Probabilité que la population s’éteigne en temps infini : q = limn→+∞ qn. Ellesatisfait q = g(q).

Deux cas possibles:

m ≤ 1 (cas sous-critique oucritique): q = 1. Extinction.

m > 1 (cas sur-critique): q < 1.Persistance avec probabilitépositive.

Fin de la Leçon 1: Variables aléatoires42 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 32

/ 35

-

Information et Entropie

X variable aléatoire discrète et pi = P(X = xi ).

Entropie de X sous P:

HP(X ) =∑

i

pi ln1pi

= −∑

i

pi ln pi .

HP(X ) ≥ 0 .HP(X ) = 0⇐⇒ X déterministe (X (ω) = x ∈ R).HP(X ) concave en les (pi )i :∑

i

λi pi ln1pi≤ p ln 1

p, dès que

∑i

λi = 1 , p =∑

i

λipi .

De plus , HP(X ) ≤∑

i

pi ln1qi, pour tous qi ≥ 0,

∑i

qi = 1.

( On utilise ln x ≤ x − 1).

Fin de la Leçon 1: Variables aléatoires43 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 33

/ 35

-

Maximisation entropie sous contrainte

On se donne une fonction de poids w(x) et un nombre m.

On veut maximiser HP(X ) comme fonction de (pi ) sous la contrainte demoment

EP(w(X )) =∑

i pi w(xi ) = m .

Idée: on cherche Q telle que EQ(w(X )) =∑

i w(xi ) qi = m.

Prenons

qi =e−λw(xi )

s(λ), avec s(λ) =

∑i

e−λw(xi ).

On a∑

i w(xi ) e−λ w(xi )

s(λ) = −s′(λ)s(λ) = m.

Supposons qu’il y ait une unique solution à cette équation.

Alors,∑

i pi ln1qi

=∑

i (pi ln s(λ) + λpi w(xi )) = ln s(λ) + λm ne dépend pasdes pi .

Fin de la Leçon 1: Variables aléatoires44 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 34

/ 35

-

Ainsi, HQ(X ) =∑

i pi ln1qi

est l’unique maximum entropique sous lacontrainte de moment.

La mesure (qi )i∈N s’appelle mesure de Gibbs.

Exemple: w(x) = x , X ∈ N.

s(λ) =∑

i∈N e−λ i = 11−e−λ . Alors

−s′(λ)

s(λ)= m⇐⇒ e−λ = m

1 + m.

Nous en déduisons que qi = (1− e−λ) e−λ i : (qi )i∈N est la loi géométrique deparamètre m1+m .

Cela nous donne une autre manière de caractériser la loi géométrique.

Fin de la Leçon 1: Variables aléatoires45 () MAP 311 - X2013Rappel: nous avons construit l’espace de probabilité (Ω,A, P), avec une approche ensembliste. 35

/ 35

![I. PHONÉTIQUE ET PRONONCIATION FREN 301 LEÇON 2 PRONONCIATION DU "E" ACCENT LES SONS [e] et [ε]](https://static.fdocument.org/doc/165x107/551d9d82497959293b8bc8e8/i-phonetique-et-prononciation-fren-301-lecon-2-prononciation-du-e-accent-les-sons-e-et-.jpg)

![PHYSICS 311: Classical Mechanics 2015mimas.physics.drexel.edu/cm1/midterm_2015_sol.pdfPHYSICS 311: Classical Mechanics { Midterm Soluion Key 2015 1. [15 points] A particle of mass,](https://static.fdocument.org/doc/165x107/60ba83798f1b8638fc44a212/physics-311-classical-mechanics-physics-311-classical-mechanics-midterm-soluion.jpg)